2022. 8. 15. 14:01ㆍView Synthesis

InfoNeRF: Ray Entropy Minimization for Few-Shot Neural Volume Rendering

Mijeong Kim, Seonguk Seo, Bohyung Han

Abstract

신경 암묵적 표현을 기반으로 한 퓨샷 새로운 뷰 합성을 위한 정보 이론적 정규화 기법을 제시한다.

제안된 접근 방식은 각 ray에서 밀도의 엔트로피 제약을 부과하여 불충분한 관점으로 인해 발생하는 잠재적인 재구성 불일치를 최소화한다.

또한 모든 학습 이미지가 거의 중복된 관점에서 획득될 때 잠재적인 퇴보 문제를 완화하기 위해, 우리는 관점이 약간 다른 추가 ray의 정보 이득을 제한하여 공간 평활도 제약을 추정된 이미지에 추가로 통합한다.

우리 알고리즘의 주요 아이디어는 재구성된 장면을 개별 ray를 따라 압축하고 이웃의 ray에 걸쳐 일관되게 만드는 것이다.

제안된 정규화기는 NeRF를 기반으로 하는 기존 신경 볼륨 렌더링 기술의 대부분에 간단한 방식으로 연결될 수 있다.

단순함에도 불구하고, 우리는 여러 표준 벤치마크에서 큰 폭으로 기존 신경 뷰 합성 방법에 비해 지속적으로 향상된 성능을 달성한다.

1. Introduction

자연 장면의 3D 구조를 이해하는 것은 객체 인식, 사실적 렌더링, 자율 주행, 가상 현실 등 다양한 고급 컴퓨터 비전 응용 프로그램에 중요한 단계이다.

최근의 딥러닝의 발전은 높은 충실도의 3D 재구성 및 인식을 가능케 하지만, 데이터 형식의 비구조적 특성, 높은 메모리 요구, 원칙적인 아키텍처의 부족으로 인해 3D 데이터로 학습하는 것은 본질적으로 2D 이미지를 기반으로 하는 상대보다 어렵다.

따라서, 많은 연구자들은 적절한 학습 알고리즘과 계산 비용을 줄이기 위한 방법으로 표준 모델을 조사하고, 다양한 어려운 과제를 해결하려고 노력한다.

신경 암묵적 표현을 기반으로 한 새로운 뷰 합성은 Neural Radiance Field (NeRF)[20]이 도입된 이후 요즘 많은 관심을 끌고 있는 3D 학습 과제 중 하나이다.

NeRF는 3D 장면 구조의 명시적인 모델링 없이 정확한 3D 재구성 결과를 제공하지만, 여러 보정된 카메라에서 캡처한 많은 이미지의 요구 사항은 방법의 적용 가능성을 방해한다.

따라서, 최근 몇 가지 접근 방식은 높은 계산 비용을 줄이고 데이터 세트와 관련된 제약을 완화하는 것을 목표로 한다[7, 11, 37].

이 연구 라인에서는 제한된 수의 학습 이미지만 액세스할 수 있고 타겟 장면의 객체 범주 및 의미 구조와 같은 다른 prior 정보를 사용할 수 없는 퓨샷 prior-free 뷰 합성 과제를 탐구한다.

이 과제에 대한 몇 가지 선행 연구가 있지만, 거의 몇 가지 사례[11]로 거의 작동하지 않거나 외부 모듈을 사용하여 대응 관계를 찾기 위해 좁은 베이스라인 가정을 요구한다[7].

다른 접근 방식은 객체 클래스 또는 피쳐와 같은 장면의 prior 지식에 의존한다.

예를 들어 PixelNeRF [37]는 보이지 않는 뷰에서 누락된 정보를 보상하기 위해 보이는 이미지에서 추출된 피쳐를 활용하는 반면 [14, 23]은 새로운 뷰 합성에서 특정 객체 클래스에 초점을 맞춘다.

우리는 기존의 퓨샷 새로운 뷰 합성 방법의 근본적인 단점, 즉 렌더링된 이미지에서 노이즈, 블러 또는 아티팩트를 생성하는 일관성 없는 재구성, 보이는 뷰에 과적합하여 퇴보하거나 사소한 해결책으로 이어지는 문제를 해결한다.

InfoNeRF라고 하는 제안된 접근 방식은 각 ray에서 엔트로피 최소화에 의해 달성되는 추정된 장면에 희소성을 부과하여 재구성 불일치를 완화한다.

과적합 문제는 관점 변화와 관련하여 재구성의 평활성을 시행함으로써 처리되며, 이는 약간 다른 관점 쌍에서 정보 이득을 최소화함으로써 제어된다.

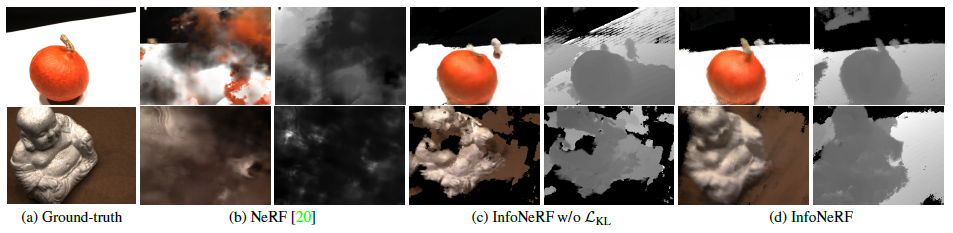

그림 1은 렌더링된 이미지와 우리 모델에 의해 추정된 depth 맵의 뛰어난 품질을 보여 주며, 넓은 베이스라인을 가진 4개의 입력 뷰만을 사용하여 명확한 객체 경계와 미세 구조를 설명한다.

전반적으로, 우리 알고리즘의 주요 기여와 이점은 다음과 같이 요약된다:

• 볼륨 렌더링을 위한 신경 암묵적 표현의 정규화를 위한 새로운 정보 이론적 접근 방식인 InfoNeRF를 제안한다.

우리의 방법은 기존의 퓨샷 새로운 뷰 합성 기술의 주요 단점을 지적하고, ray 엔트로피 최소화 및 ray 정보 이득 감소라는 두 가지 효과적인 정규화 체계를 도입한다.

• InfoNeRF는 일반적인 정규화 기법이며 복셀이나 메시와 같은 다른 외부 데이터 구조나 추가적인 학습 가능한 매개 변수가 필요하지 않기 때문에 장면 prior과 관계없이 다양한 신경 볼륨 렌더링 알고리즘에 적용할 수 있다.

• 제안된 정규화 기법은 단순함에도 불구하고 과적합을 통해 여러 뷰에 걸친 재구성 불일치를 완화하고 퇴보한 솔루션을 방지하는 데 효과적인 것으로 나타났다.

우리는 퓨샷 새로운 뷰 합성을 위한 몇 가지 표준 벤치마크에서 InfoNeRF의 뛰어난 성능을 보여준다.

• 우리가 아는 한 InfoNeRF는 prior 정보 없이 넓은 베이스라인 이미지 데이터 세트에서 퓨샷 새로운 뷰 합성을 수행하는 최초의 NeRF 변형이다.

2. Related Work

2.1. Novel View Synthesis

새로운 뷰 합성은 학습 이미지 세트가 주어진 3D 장면에 대한 기하학적 및 측광학적 이해를 통해 사실적인 이미지를 렌더링하는 것을 목표로 한다.

이 문제를 해결하기 위해 전통적으로 라이트 필드[15, 29, 35] 또는 이미지 기반 렌더링[3–6, 27] 접근법이 사용되어 왔으며, 최근 딥러닝[8, 9, 39, 40]에 기반한 접근법이 점점 더 주목을 받고 있다.

특히 NeRF[20]는 미분 가능한 볼륨 렌더링에 다층 퍼셉트론을 성공적으로 적용하여 사진 사실적인 렌더링 결과를 달성한다.

다음 작업은 동적 뷰 합성[16], 자체 보정 뷰 합성[33], 실시간 렌더링[21, 34, 36], 재조명[28] 및 안티앨리어싱[1]과 같은 다양한 측면에서 NeRF를 확장하려고 시도한다.

NeRF 기반 모델은 인상적인 성능을 달성했지만, 밀도 높은 장면 샘플링이 필요하여 실제 시나리오에 적용하기 어렵다는 공통된 단점이 있다.

보정된 카메라로 캡처한 많은 이미지의 필요성을 줄임으로써 적용 가능성을 향상시키기 위해 퓨샷 볼륨 렌더링 작업을 해결한다.

2.2. Few-shot Novel View Synthesis

희박한 관찰이 주어진 장면의 새로운 뷰를 합성하기 위해, depth가 뷰 합성 및 3D 재구성을 위한 귀중한 원천이기 때문에 일부 알고리즘은 이미지에서 depth 맵을 추정한다.

depth 정보는 퓨샷 뷰 합성을 위한 복잡한 장면[7]에서 depth 유도 이미지 보간[9,24], 다중 평면 이미지 예측[31] 및 학습된 지오메트리 정규화에 중요한 역할을 한다.

그러나 이러한 방법은 depth supervision 또는 외부 depth 추정 모듈, 예를 들어, 멀티뷰 스테레오 또는 COLMAP SfM[25]과 함께 이미지를 학습해야 하며, 잘못된 depth 예측으로 인해 큰 투영 오류가 발생할 수 있다.

한계를 극복하기 위해, 여러 접근 방식은 NeRF용 이미지 인코더를 도입하여 색과 불투명도를 추정하거나 [14, 23, 37] 보이는 이미지와 렌더링된 새로운 뷰 사이의 의미적 일관성을 달성함으로써 멀티 뷰 피처 의미론[11]을 활용한다.

이러한 전략은 의미론적 prior 학습을 용이하게 하고 몇 장의 사진만으로 새로운 뷰를 합성할 수 있게 한다.

전술한 작업과 달리 제안된 알고리즘은 prior 정보나 사전 학습된 추가 인코더에 의존하지 않는다.

우리의 정규화 기법은 위에서 논의된 다른 방법과 직교하며 기존의 퓨샷 볼륨 렌더링 접근법에 바로 통합될 수 있다.

일부 명시적 표현 방법[17, 36]은 신경 볼륨 렌더링을 위한 희소성 제약을 통합하며, 이는 작업을 직접 다루지는 않지만 퓨샷 새로운 뷰 합성에도 유용할 수 있다.

Yu et al. [36]은 희소성 prior loss가 있는 옥트리 구조의 변형을 채택하여 관찰되지 않은 영역에 해당하는 트리의 노드 하위 집합을 제거한다.

반면, Lombardi et al. [17]은 볼륨 렌더링을 위해 복셀 그리드를 통해 ray marching을 수행하고 희소 공간 그래디언트를 적용하여 복셀 빈도의 총 변동을 정규화한다.

우리의 방법은 또한 엔트로피 제약 조건을 통해 희소성을 사용하지만, 알고리즘이 외부 데이터 구조를 필요로 하지 않고 명시적 표현을 저장하기 위해 바인딩된 메모리에 시달리기 때문에 명시적 방법보다 더 일반적이다.

3. Preliminaries: NeRF

Neural Radiance Fields (NeRF)[20]는 신경 암시 함수를 가진 3D 장면을 나타내는 새로운 프레임워크이며, 여기서 일반적으로 MLP에 의해 제공되는 신경망 f(·,·)는 3D 포인트 x = (x, y, z)와 단위 뷰 방향 d = (θ, ϕ)를 체적 밀도 σ뿐만 아니라 방출된 RGB 색상 c = (r, g, b)에 매핑한다.

고전적인 볼륨 렌더링 이론[19]에 따르면, 타겟 픽셀의 렌더링된 RGB 색상은 ray를 따라 색상과 밀도를 통합하여 얻는다.

실제로, ray 상의 모든 연속점들의 출력값 (c, σ)은 관찰할 수 없기 때문에, 포인트의 부분 집합을 샘플링하고 다음과 같은 직교 규칙을 사용하여 ray의 렌더링된 색상을 근사화한다:

, 여기서 r은 ray, N은 샘플의 수, δ_i는 i^th 점과 인접한 샘플 사이의 거리를 나타낸다.

T_i는 i^th 지점까지 ray를 따라 누적된 투과율을 나타내며, 이는

에 의해 주어진다.

ray의 점들은 렌더링 효율을 높이기 위해 2단계 계층적 방식으로 샘플링된다.

첫 번째 단계에서는 포인트를 균일하게 샘플링하고, 두 번째 단계에서는 첫 번째 단계에서 추정된 밀도를 기반으로 중요도 샘플링을 수행합니다.

모든 프로세스가 완전히 미분될 수 있기 때문에, radiance fields를 인코딩하는 신경망은 다음 objective

로 최적화된다, 여기서 R은 ray의 집합을 나타낸다.

위치 인코딩은 또한 MLP 이전에 입력 좌표(x, d)를 더 높은 차원의 공간에 매핑하기 위해 사용되며, 이는 고주파 장면을 표현하는 데 도움이 된다.

NeRF[20]는 뛰어난 사진-현실적 뷰 합성 결과를 달성하지만, 일반적으로 보정된 카메라에 의해 조밀하게 캡처된 많은 이미지가 필요하다.

이러한 데이터 수집 문제를 완화하기 위해 간단하지만 효과적인 퓨샷 새로운 뷰 합성 접근법을 제안한다.

4. Proposed Method

우리의 접근 방식은 장면에 대한 prior 지식 없이 몇 개의 입력 이미지만을 기반으로 강력한 신경 볼륨 렌더링 모델을 학습한다.

우리는 입력 뷰의 부족으로 인한 재구성 불일치와 과적합으로 인한 퇴화를 완화하는 방법에 중점을 둔다.

이 섹션에서는 우리의 목표를 달성하기 위해 NeRF 기반 모델에 부과되는 제안된 정보 이론적 정규화에 대해 논의한다.

4.1. Motivation

사용 가능한 뷰 수가 적기 때문에 퓨샷 3D 재구성 및 볼륨 렌더링은 본질적으로 노이즈가 많은 추정 및 퇴화 솔루션을 초래하기 쉽다.

예를 들어, 그림 2a는 NeRF가 주로 뷰포인트 부족으로 인해 3D 장면을 정확하게 재구성하지 못함을 보여줍니다.

또한 학습된 모델은 특히 학습 이미지의 관점이 서로 유사할 때 보이는 이미지에 심하게 과적합되고 퇴화된 솔루션으로 수렴된다.

결과적으로, 그림 2b에 표시된 것처럼 뷰를 약간만 변경하면 렌더링이 실패합니다.

4.2. Regularizatioin by Ray Entropy Minimization

재구성 불일치를 완화하기 위해 재구성된 장면에 희소성 제약을 부과하는데, 이는 추가 정규화 항을 사용하여 각 ray 밀도 함수의 엔트로피를 최소화함으로써 달성된다.

이 제약 조건은 장면에서 ray가 물체나 배경을 따라 샘플링된 점의 작은 부분 집합과 나머지 점만 노이즈를 관찰할 가능성이 있기 때문에 합리적이다.

Ray density

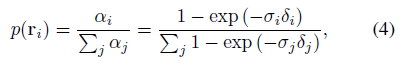

ray 엔트로피에 대해 논의하기 전에 먼저 p(r)로 표시된 정규화된 ray 밀도를 다음과 같이 정의합니다:

, 여기서 r_i(i = 1, ..., N)는 ray에서 샘플링된 점, σ_i는 r_i에서 관찰된 밀도, δ_i는 r_i 주변의 샘플링 간격, α_i ≡ 1 − exp(−σ_i δ_i)는 r_i에서 불투명도입니다.

ray의 점들은 [20]에서와 같이 균일한 분포로부터 그 다음에 불투명도 분포로부터 도출되는 2단계 방식으로 샘플링된다.

우리는 실제로 불규칙한 샘플링 간격 δ_i를 고려하기 위해 밀도 σ_i 대신 (4)에서 p(r_i)를 계산하기 위해 불투명도 α_i를 사용한다는 것에 주목한다.

Ray entropy

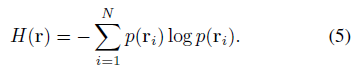

Shannon Entropy [26]에 이어, 우리는

에 의해 주어진 이산 ray 밀도 함수의 엔트로피를 정의한다.

σ 및 δ 값은 (1)에서 볼륨 렌더링 절차를 수행하기 위해 이미 계산되었기 때문에, ray 엔트로피의 계산은 무시할 수 있는 추가 비용만 발생한다.

Disregarding non-hitting rays

ray 엔트로피 최소화의 한 가지 문제는 일부 ray가 장면의 어떤 물체에도 닿지 않지만 낮은 엔트로피를 갖도록 강제된다는 것이다.

이 문제로 인한 잠재적 아티팩트를 방지하기 위해 엔트로피 최소화를 위해 밀도가 낮은 ray를 무시한다.

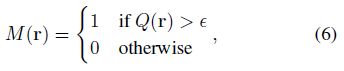

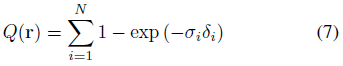

공식적으로, 우리는 마스크 변수 M(·)을 사용하여 장면에 대한 충분한 관찰을 가진 ray를 나타내며, 이는 다음과 같은 불투명도를 기반으로 한다:

, 여기서

은 누적 ray 밀도를 나타낸다.

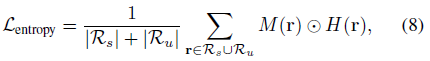

Ray entropy loss

(5)에서 계산된 ray 엔트로피를 기반으로, 우리의 ray 엔트로피 최소화 loss는 다음과 같이 정의된다:

, 여기서 R_s는 학습 이미지의 ray 세트를, R_u는 랜덤으로 샘플링된 보이지 않는 이미지의 ray 세트를, ⊙는 요소별 곱셈을 나타낸다.

참고로 NeRF 기반 모델은 픽셀 색상의 ground truth가 없기 때문에 보이지 않는 이미지의 ray를 사용할 수 없지만 엔트로피 정규화에는 ground truth가 필요 없기 때문에 우리 모델은 이를 활용할 수 있다.

우리는 더 나은 장면 재구성을 위해 관찰되지 않은 관점에서도 ray를 활용하는 것이 유익하다는 것을 관찰한다.

Comparison with existing methods

장면 표현이나 모델에 제약을 가하는 몇 가지 이전 작업만 존재하지만, 그들의 목표는 예를 들어 퓨샷 학습 시나리오를 고려하지 않고 재구성 품질을 개선하거나 실시간 처리를 달성하는 데 초점을 맞추는 것[17, 36]과 다르다.

또한 복셀 표현을 기반으로 3D 볼륨 엔트로피에 의존하기 때문에 3D 밀도 또는 점유 맵을 추정하기 위해 많은 샘플을 그려야 하므로 공간 및 시간 복잡성 측면에서 계산 비용이 많이 든다.

반면, InfoNeRF는 1D 샘플링을 통해 ray를 따라 엔트로피 최소화를 사용하므로 3D 볼륨 엔트로피를 기반으로 하는 방법에 비해 매우 효율적으로 실행된다.

4.3. Regularization by Information Gain Reduction

우리의 관찰에 따르면, 학습 이미지가 충분히 다양한 관점을 가질 때, 제안된 엔트로피 정규화는 퓨샷 설정에서 렌더링된 이미지와 3D depth 추정의 품질을 향상시키는 데 매우 도움이 된다.

그러나 모든 학습 이미지가 서로 유사한 관점을 가진 경우 모델은 보이는 이미지에 지나치게 적합하기 쉽고 보이지 않는 뷰로 일반화하지 못한다.

이것은 아마도 다양한 관찰의 부족으로 학습된 모델이 퇴화되고 사소한 해결책을 찾게 되기 때문일 것이다.

앞서 언급한 한계를 완화하기 위해, 우리는 이웃의 ray에 걸쳐 일관된 밀도 분포를 보장하기 위해 추가적인 정규화 항을 도입한다.

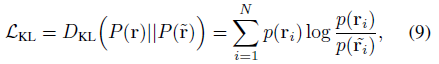

관찰된 ray r이 주어지면, 우리는 ~r로 표시되는 약간 다른 관점을 가진 다른 ray를 샘플링하고 두 ray의 밀도 함수 사이의 KL 발산을 최소화한다.

이 objective의 동기는 두 개의 유사한 관점에서 관찰한 내용을 충분히 일관되게 만들어 모델이 인근 관점으로 일반화되도록 하는 것이며, 이는 공간적 관점 섭동에 대한 재구성 결과에 대한 평활성을 적용함으로써 달성된다.

정보 이득 감소에 대한 정규화 loss는

에 의해 주어지며, 여기서 ~r_i는 ray ~r의 관측을 위한 샘플링된 점이다.

우리의 구현에서, 우리는 r의 카메라 포즈를 -5˚에서 5˚ 범위에서 약간 회전시킴으로써 ~r을 얻는다.

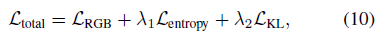

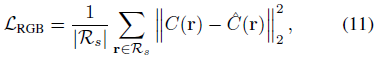

4.4. Overall Objective

퓨샷 신경 볼륨 렌더링을 위한 신경 암시적 모델을 학습하기 위한 총 loss 함수는

에 의해 제공되며, 여기서 λ_1과 λ_2는 정규화 항에 대한 균형 항이다.

(3)에서 언급한 바와 같이, L_RGB로 표시되는 재구성 loss는

에 의해 주어지는데, 이는 관찰되지 않은 관점에서도 ray를 활용하는 L_entropy 및 L_KL과 달리 픽셀 레벨의 ground truth를 가진 학습 이미지의 ray 세트만 사용한다.

5. Experiments

표준 벤치마크에서 InfoNeRF라고 하는 제안된 접근 방식의 효과를 입증한다.

또한 이 섹션에서는 실험 결과를 기반으로 알고리즘의 특성에 대해 논의한다.

5.1. Datasets

우리는 알고리즘을 평가하기 위해 사용된 세 가지 벤치마크의 세부 정보를 설명하는데, 여기에는 Realistic Synthetic 360˚[20], ZJU-MoCap[23] 및 DTU[12] 데이터 세트가 포함된다.

Realistic Synthetic 360˚

이 벤치마크는 신경 볼륨 렌더링에 일반적이며, 뷰 의존적 광 전송 효과가 있는 8개의 합성 장면이 포함되어 있다.

각 장면의 중심에는 물체가 있고, 400개의 렌더링된 이미지는 서로 다른 시점을 가진 내향 가상 카메라에서 나온다.

퓨샷 학습의 경우 각 장면의 학습 이미지 100개 중 4개의 시점을 랜덤으로 샘플링하고 200개의 테스트 이미지를 평가에 사용한다.

ZJU-MoCap

이 데이터 세트는 23개의 보정된 카메라에서 인간의 움직임을 포착하는 멀티 뷰 비디오로 구성된다.

[23]에 이어, 우리는 4개의 균일하게 분산된 관점을 샘플링하여 학습 세트를 구성하고 나머지 이미지를 테스트에 사용한다.

DTU MVS Dataset (DTU)

이 데이터 세트의 이미지는 제어된 환경에서 보정된 카메라에 의해 캡처된 복잡한 실제 장면을 포함한다.

수집된 모든 이미지는 유사한 시점을 가지며 장면의 한 면만 향합니다.

우리는 15개의 장면에서 실험을 수행하는데, 49개의 뷰 중 3개의 이미지로 모델을 최적화하고 나머지 46개의 뷰로 테스트한다.

5.2. Implementation and Evaluation

Implementation details

우리의 구현은 PyTorch[22]를 기반으로 합니다.

초기 학습 속도가 5×10-4인 Adam 최적화 도구 [13]를 사용하며, 이는 250,000번 반복할 때마다 10배씩 지수적으로 감소한다.

L_KL에 대한 균형 항은 5,000회 반복할 때마다 2의 배수로 감쇠한다.

우리는 각각 |R_s| 및 |R_u|로 표시되는 보이는 뷰와 관찰되지 않는 뷰의 ray 수를 1024로 설정하고, 우리의 실험은 단일 NVIDIA Titan XP GPU로 수행된다.

Metrics

표준 이미지 품질 메트릭, 피크 신호 대 잡음비(PSNR) 및 구조 유사성(SSIM)을 기반으로 새로운 뷰 렌더링 품질을 평가한다[32].

또한 지각 메트릭, 학습된 지각 이미지 패치 유사성(LPIPS) [38], 프레셰 인셉션 거리(FID) [10] 및 커널 인셉션 거리(KID) [2]를 사용한다.

LPIPS는 이미지 쌍 사이의 정규화된 피쳐 거리를 추정하는 반면, FID와 KID는 두 이미지 세트 사이의 거리를 Inception 표현[30]으로 계산한다.

5.3. Results

5.3.1 Realistic Synthetic 360˚

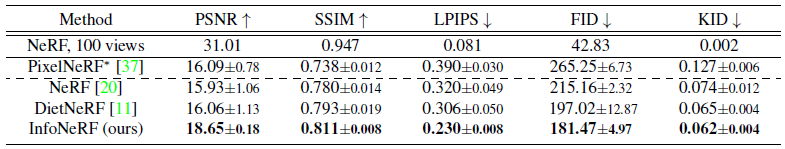

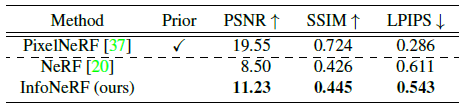

우리는 우리의 접근 방식을 Realistic Synthetic 360˚ dataset 데이터 세트에서 NeRF[20], DietNeRF[11] 및 PixelNeRF[37]와 비교한다.

NeRF, DietNeRF 및 InfoNeRF(ours)는 랜덤으로 샘플링된 4개의 뷰로 처음부터 학습된다.

다른 것과 달리, PixelNeRF는 밀집된 입력 뷰로 DTU[12] 데이터 세트에서 사전 학습되며, 우리는 두 데이터 세트 사이의 도메인 이동 문제를 처리하기 위해 4개의 샘플링된 뷰로 모델을 미세 조정한다.

표 1은 전반적인 정량적 결과를 제시하는데, 여기서 InfoNeRF는 표준 편차가 낮으면서도 상당한 마진을 갖는 모든 지표 측면에서 베이스라인 알고리즘을 일관되게 능가한다.

표 2는 8개의 개별 장면으로 PSNR 점수를 분류하는데, InfoNeRF는 모든 장면에서 분명히 상당한 이득을 얻는다.

SSIM과 LPIPS가 동일한 경향을 보이는 결과는 우리의 보충 문서를 참조하십시오.

그림 1은 새로운 관점에 대한 정성적 결과를 보여준다, 여기서 InfoNeRF는 모든 비교 방법과 비교하여 렌더링된 이미지에서 뛰어난 품질을 보여준다.

그림 1(f)과 같이 InfoNeRF가 추정한 depth 맵의 품질은 인상적이다, 우리는 모든 비교 알고리즘이 종종 3D 구조를 정확하게 재구성하지 못한다는 것을 알아차리고 DietNeRF는 높은 수준의 semantic 일관성 loss로 인해 색상 왜곡까지 보인다.

5.3.2 ZJU-MoCap

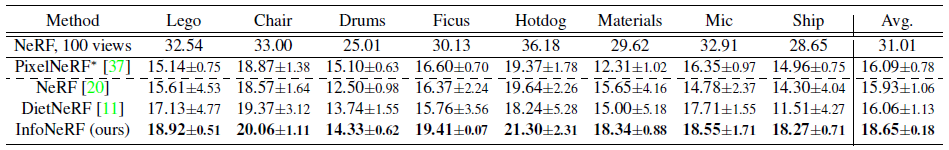

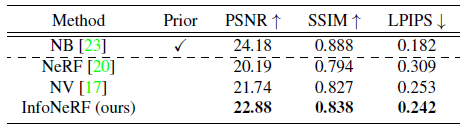

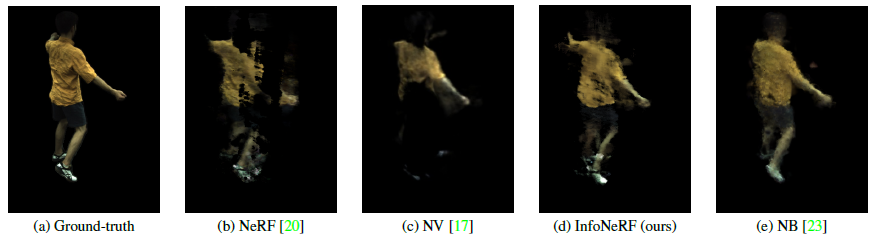

ZJU-MoCap 데이터 세트의 경우, InfoNeRF는 모든 알고리즘이 4개의 이미지로 학습되는 NeRF[20], Neural Volume(NV)[17] 및 Neural Body(NB)[23]와 비교하여 평가된다.

참고로, NB는 사전에 SMPL[18]로 표시된 사전 학습된 인체 모델을 사용하기 때문에, NB의 성능은 다른 모든 방법의 상한으로 간주될 수 있다.

표 3에는 ZJU-MoCap 데이터 세트에 대한 실험 결과가 요약되어 있으며, 여기서 InfoNeRF는 테스트된 모든 메트릭 측면에서 prior를 사용하지 않고도 방법 중 최고의 성능을 달성한다.

그림 3은 비교된 모든 방법의 정성적 결과를 보여주며, InfoNeRF가 제공하는 재구성 결과는 특히 정확하다.

5.3.3 DTU MVS Dataset (DTU)

다른 두 데이터 세트와는 달리, DTU는 각 장면의 이미지가 유사한 관점을 가지기 때문에 실질적으로 다른 특성을 갖는다.

PixelNeRF는 이 속성을 활용하여 장면 무관 모델을 성공적으로 학습하는 반면, 원본 NeRF는 퓨샷 학습으로 이 데이터 세트에서 낮은 일반화 성능을 보인다.

우리는 이 데이터 세트에서 알고리즘을 NeRF 및 PixelNeRF와 비교한다.

우리는 InfoNeRF와 NeRF를 이전에 어떤 장면도 이용하지 않고 처음부터 학습하기 때문에 장면의 보이지 않는 부분을 재구성할 수 없다.

따라서 장면 prior가 없는 알고리즘의 나이브한 평가는 바람직하지 않으며 평가 성능을 위해 각 장면의 가시 부분에 해당하는 마스크를 사용한다.

표 4는 DTU 데이터 세트에 대한 실험 결과를 나타내며, 여기서 알고리즘은 NeRF에 비해 뛰어난 성능을 달성한다.

PixelNeRF는 밀집된 입력 뷰로 DTU의 학습 분할에 대한 사전 학습을 통해 데이터 세트를 활용하기 때문에 최고의 성능을 달성한다.

5.4. Analysis

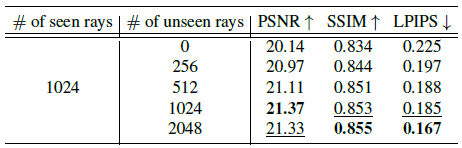

Effect of unseen view sampling

엔트로피 최소화를 위해 보이지 않는 관점에서 샘플링하는 것의 효과를 검증하기 위해, 우리는 이미지를 절반으로 줄인 상태에서 Realistic Synthetic 360°의 Chair 장면에서 보이지 않는 관점에서 나오는 ray의 수를 변경하여 알고리즘을 실행한다.

표 5는 보이지 않는 뷰에서 ray의 수를 늘리면 재구성 불일치를 완화하여 점진적인 개선을 달성하지만 ray의 수가 1,024개보다 클 때 그 이점이 포화됨을 보여준다.

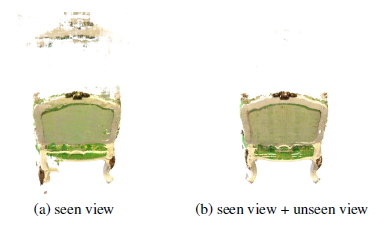

그림 4는 보이지 않는 뷰에 대한 추가 ray 샘플링의 이점을 시각화합니다.

이 예에서 ray의 사용은 노이즈 감소에 도움이 됩니다.

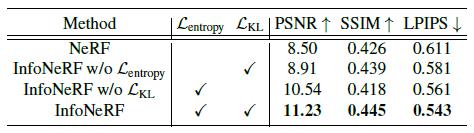

Benefit of regularization

우리는 제안된 정규화 체계, ray 엔트로피 최소화 loss, L_entropy 및 ray 정보 이득 감소 loss, L_KL의 영향을 분석한다.

표 6은 DTU 데이터 세트에 대한 InfoNeRF의 ablation 결과를 보여준다.

엔트로피 최소화 loss는 PSNR을 성공적으로 개선하지만 이 데이터 세트에서 SSIM 값은 더 나빠진다.

이는 모든 학습 이미지가 서로 유사한 관점을 가질 때 모델이 보이는 이미지에 과적합하기 쉽기 때문이다.

그러나 공간 뷰 섭동에 대한 재구성 결과에 대한 부드러움을 강제하는 정보 이득 감소 loss 덕분에, 우리의 전체 모델은 과적합 문제를 완화하고 퇴화 솔루션을 방지하는 데 도움이 된다.

상당한 관점 변화가 있는 다른 두 데이터 세트에서 엔트로피 최소화 loss는 잘 작동하는 반면 정보 이득 감소 loss는 일반적으로 작은 기여를 한다는 점에 유의한다.

그림 5는 DTU 데이터 세트의 ablation 모델과 비교하여 InfoNeRF의 렌더링 품질을 시각화한다.

정보 이득 감소 loss가 없는 InfoNeRF는 선명한 이미지를 생성하는 경향이 있지만 출력에 노이즈가 많고 depth 맵에 불일치가 있다.

반면에, 우리의 전체 알고리즘은 장면의 전체적인 모양과 기하학을 더 정확하게 재구성할 수 있다.

Realistic Synthetic 360° 데이터 세트에 대한 자세한 ablation 결과는 보조 문서의 표 C를 참조하십시오.

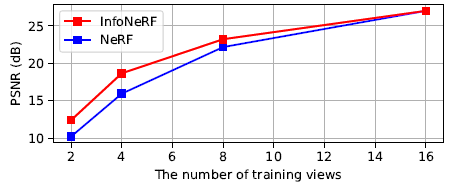

Robustness to the number of views

그림 6은 Realistic Synthetic 360°에 대한 학습을 위한 뷰 수를 변경함으로써 InfoNeRF의 성능을 보여준다.

InfoNeRF는 NeRF에 비해 8개 뷰까지 모든 메트릭 측면에서 개선된 결과를 보여주지만 뷰 수가 증가함에 따라 장점이 포화된다.

이는 부분적으로 학습 뷰의 수가 증가함에 따라 재구성된 장면의 불확실성이 감소하여 엔트로피 정규화의 중요성이 약화되기 때문이다.

SSIM 및 LPIPS 결과는 우리의 보충 문서의 표 D를 참조하십시오.

Integration into PixelNeRF

우리 방법의 일반성을 입증하기 위해 제안된 정규화 방법을 PixelNeRF[37]에 통합하고 이 모델 버전을 InfoPixelNeRF라고 한다.

그림 7은 두 모델 간의 질적 비교를 보여주는데, 여기서 InfoPixelNeRF는 렌더링된 이미지의 블러를 크게 감소시킨다.

우리의 보충 파일의 표 E는 상세한 비교를 보여준다.

6. Conclusion

우리는 퓨샷 새로운 뷰 합성을 위한 정보 이론적 정규화 기법을 제안했다.

기존의 퓨샷 뷰 합성 방법은 일관성 없는 재구성을 겪는데, 이는 렌더링된 이미지에서 노이즈, 블러 또는 아티팩트를 생성하고 보이는 뷰에 과적합하여 솔루션을 퇴보시킨다.

이러한 문제를 해결하기 위해 두 가지 효과적인 정규화 체계인 ray 엔트로피 최소화 및 ray 정보 이득 감소를 도입했다.

단순함에도 불구하고 제안된 방법은 여러 뷰에서 재구성 불일치를 완화하는 데 효과적인 것으로 나타났다.

우리는 여러 표준 벤치마크에서 방법의 뛰어난 성능을 입증했으며, 광범위한 분석을 통해 접근 방식에 대한 자세한 분석을 수행했다.